Anthropic lança ferramenta de revisão de código para verificar inundação de código gerado por IA

Quando se trata de codificação, o feedback dos colegas é crucial para detectar bugs antecipadamente, manter a consistência em uma base de código e melhorar a qualidade geral do software.

A ascensão da “vibe coding” – usando ferramentas de IA que recebem instruções fornecidas em linguagem simples e geram rapidamente grandes quantidades de código – mudou a forma como os desenvolvedores trabalham. Embora essas ferramentas tenham acelerado o desenvolvimento, elas também introduziram novos bugs, riscos de segurança e códigos mal compreendidos.

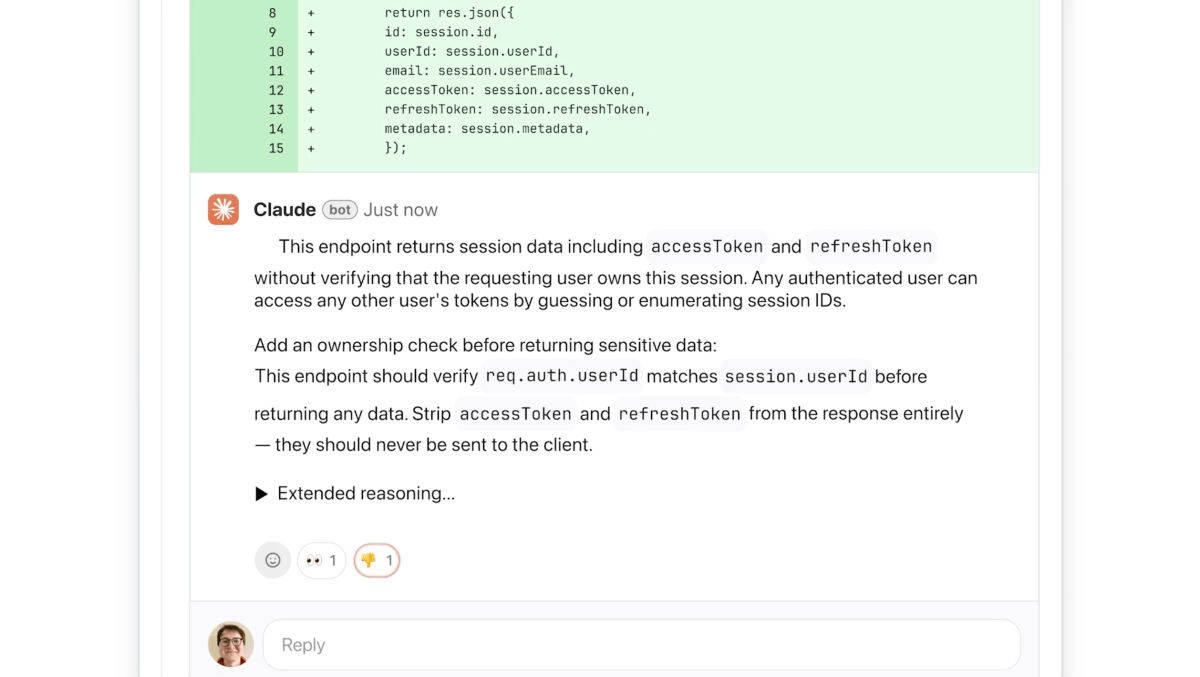

A solução da Anthropic é um revisor de IA projetado para detectar bugs antes que eles cheguem à base de código do software. O novo produto, chamado Code Review, lançado segunda-feira em Código Claude.

“Temos visto um grande crescimento no Claude Code, especialmente dentro da empresa, e uma das perguntas que continuamos recebendo dos líderes empresariais é: agora que o Claude Code está lançando um monte de pull requests, como posso garantir que eles sejam revisados de maneira eficiente?” Cat Wu, chefe de produto da Anthropic, disse ao TechCrunch.

Solicitações pull são um mecanismo que os desenvolvedores usam para enviar alterações de código para revisão antes que essas alterações cheguem ao software. Wu disse Código Claude aumentou drasticamente a produção de código, o que aumentou as revisões de solicitações pull que causaram um gargalo no envio do código.

“Code Review é a nossa resposta para isso”, disse Wu.

O lançamento do Code Review pela Anthropic – chegando primeiro aos clientes Claude for Teams e Claude for Enterprise na visualização da pesquisa – chega em um momento crucial para a empresa.

Evento Techcrunch

São Francisco, Califórnia

|

13 a 15 de outubro de 2026

Na segunda-feira, Antrópico entrou com duas ações judiciais contra o Departamento de Defesa em resposta à designação da agência de Antrópico como um risco na cadeia de abastecimento. A disputa provavelmente fará com que a Anthropic se apoie mais fortemente em seu negócio empresarial em expansão, que viu as assinaturas quadruplicarem desde o início do ano. Código Claudea receita da taxa de execução ultrapassou US$ 2,5 bilhões desde o lançamento, de acordo com a empresa.

“Este produto é muito direcionado aos nossos usuários corporativos de maior escala, como empresas como Uber, Salesforce, Accenture, que já usam o Claude Code e agora querem ajuda com a grande quantidade de (solicitações pull) que estão ajudando a produzir”, disse Wu.

Ela acrescentou que os líderes de desenvolvimento podem ativar o Code Review para execução padrão para todos os engenheiros da equipe. Uma vez ativado, ele se integra ao GitHub e analisa automaticamente solicitações pull, deixando comentários diretamente no código explicando possíveis problemas e sugestões de correções.

O foco está na correção de erros lógicos em detrimento do estilo, disse Wu.

“Isso é realmente importante porque muitos desenvolvedores já viram feedback automatizado de IA antes e ficam irritados quando isso não é imediatamente acionável”, disse Wu. “Decidimos que vamos nos concentrar puramente nos erros lógicos. Dessa forma, estamos identificando as coisas de maior prioridade para corrigir.”

A IA explica o seu raciocínio passo a passo, descrevendo o que pensa ser o problema, porque pode ser problemático e como pode ser potencialmente resolvido. O sistema rotulará a gravidade dos problemas usando cores: vermelho para maior gravidade, amarelo para possíveis problemas que valem a pena revisar e roxo para problemas vinculados a códigos pré-existentes ou bugs históricos.

Wu disse que faz isso de forma rápida e eficiente, contando com vários agentes trabalhando em paralelo, com cada agente examinando a base de código de uma perspectiva ou dimensão diferente. Um agente final agrega e classifica as descobertas, removendo duplicatas e priorizando o que é mais importante.

A ferramenta fornece uma luz análise de segurançae os líderes de engenharia podem personalizar verificações adicionais com base nas práticas recomendadas internas. Wu disse que o Anthropic foi lançado mais recentemente Segurança do Código Claude fornece uma análise de segurança mais profunda.

A arquitetura multiagente significa que este pode ser um produto que consome muitos recursos, disse Wu. Semelhante a outros serviços de IA, o preço é baseado em tokens e o custo varia dependendo da complexidade do código – embora Wu estimou que cada revisão custaria em média US$ 15 a US$ 25. Ela acrescentou que é uma experiência premium e necessária, pois as ferramentas de IA geram cada vez mais código.

“(Code Review) é algo que vem de uma quantidade absurda de atração de mercado”, disse Wu. “À medida que os engenheiros desenvolvem com o Claude Code, eles percebem o atrito na criação de um novo recurso (diminuição) e uma demanda muito maior por revisão de código. Portanto, temos esperança de que, com isso, permitiremos que as empresas construam mais rápido do que jamais conseguiram antes e com muito menos bugs do que nunca.”

Publicar comentário