Osaurus traz modelos de IA locais e em nuvem para o seu Mac

À medida que os modelos de IA se tornam cada vez mais comoditizados, as startups correm para construir a camada de software que os sustenta. Um participante interessante neste espaço é Ossauroum servidor LLM de código aberto exclusivo da Apple que permite aos usuários alternar entre diferentes modelos locais de IA, localmente ou na nuvem, enquanto mantêm seus arquivos e ferramentas em seu próprio hardware.

Osaurus evoluiu a partir da ideia de um companheiro de IA para desktopDinoki, co-fundador da Osaurus Terêncio Pae descrito como uma espécie de “Clippy com tecnologia de IA”. Os clientes de Dinoki perguntaram por que deveriam comprar o aplicativo se ainda tinham que pagar pelos tokens – as unidades de uso que as empresas de IA cobram para processar solicitações e gerar respostas.

Isso fez com que Pae pensasse mais profundamente sobre como executar a IA localmente.

“Foi assim que o Osaurus começou”, disse Pae, ex-engenheiro de software na Tesla e Netflix, ao TechCrunch por telefone. A ideia, explicou ele, era tentar administrar um assistente de IA localmente. “Você pode fazer praticamente tudo localmente no seu Mac, como navegar em seus arquivos, acessar seu navegador, acessar as configurações do sistema. Achei que essa seria uma ótima maneira de posicionar o Osaurus como uma IA pessoal para indivíduos.”

Pae começou a construir a ferramenta em público como um projeto de código abertoadicionando recursos e corrigindo bugs ao longo do caminho.

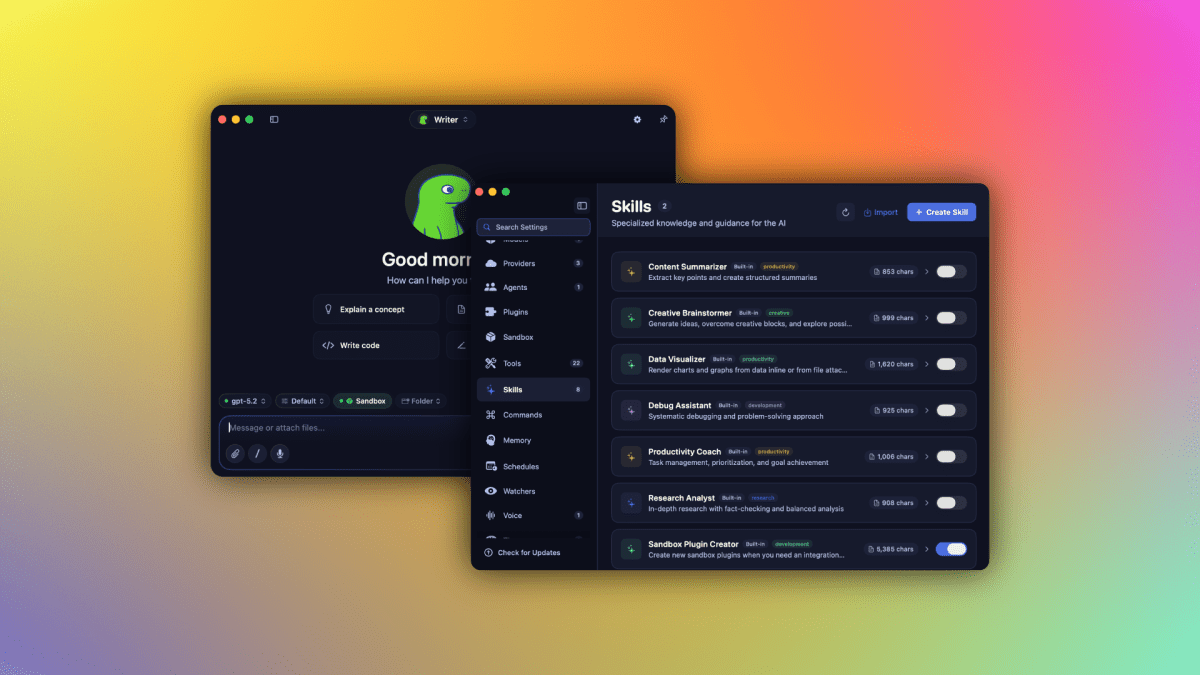

Hoje, Ossauro pode conectar-se de forma flexível com modelos de IA hospedados localmente ou provedores de nuvem como OpenAI e Anthropic. Os usuários podem escolher livremente quais modelos de IA usarão e manter outros aspectos da experiência de IA em seu próprio hardware, como a memória dos modelos ou seus arquivos e ferramentas.

Dado que diferentes modelos de IA têm diferentes pontos fortes, a vantagem deste sistema é que os utilizadores podem mudar para o modelo de IA que melhor se adapta às suas necessidades.

Essa estrutura faz do Osaurus o que chamamos de “arnês” – uma camada de controle que conecta diferentes modelos de IA, ferramentas e fluxos de trabalho por meio de uma única interface, semelhante a ferramentas como OpenClaw ou Hermes. No entanto, a diferença é que essas ferramentas geralmente são destinadas a desenvolvedores que conhecem bem um terminal. E às vezes, como no caso do OpenClaw, eles podem apresentar problemas de segurança e falhas com os quais se preocupar.

Enquanto isso, o Osaurus apresenta uma interface fácil de usar que os consumidores podem usar e aborda questões de segurança executando coisas em uma sandbox virtual isolada por hardware. Isso limita a IA a um determinado escopo, mantendo seu computador e seus dados seguros.

É claro que a prática de executar modelos de IA em sua máquina ainda está em seus primórdios, visto que consome muitos recursos e depende de hardware. Para executar modelos locais, seu sistema precisará de pelo menos 64 GB de RAM. Para rodar modelos maiores, como DeepSeek v4, Pae recomenda sistemas com cerca de 128 GB de RAM.

Mas Pae acredita que as necessidades locais de IA diminuirão com o tempo.

“Posso ver o potencial disso, porque a inteligência por potência – que é como a métrica para IA local – tem aumentado significativamente. Está em sua própria curva de inovação. No ano passado, a IA local mal conseguia terminar frases, mas hoje ela pode realmente executar ferramentas, escrever código, acessar seu navegador e encomendar coisas da Amazon (…) está ficando cada vez melhor”, disse ele.

Osaurus hoje pode executar MiniMax M2.5, Gemma 4, Qwen3.6, GPT-OSS, Llama, DeepSeek V4 e outros modelos. Ele também oferece suporte aos modelos básicos no dispositivo da Apple, à família LFM de modelos no dispositivo da Liquid AI e, na nuvem, pode se conectar a OpenAI, Anthropic, Gemini, xAI/Grok, Venice AI, OpenRouter, Ollama e LM Studio.

Como um servidor MCP (Model Context Protocol) completo, você também pode conceder acesso às suas ferramentas a qualquer cliente compatível com MCP. Além disso, ele vem com mais de 20 plug-ins nativos para Mail, Calendar, Vision, macOS Use, XLSX, PPTX, Browser, Music, Git, Filesystem, Search, Fetch e muito mais.

Mais recentemente, o Osaurus foi atualizado para incluir também recursos de voz.

Desde que o projeto foi lançado, há quase um ano, ele foi baixado mais de 112 mil vezes, de acordo com seu site.

Atualmente, os fundadores da Osaurus (que incluem o cofundador Sam Yoo) estão participando da aceleradora de startups Alliance, com sede em Nova York. Eles também estão pensando nos próximos passos, que poderiam levar o Osaurus a ser oferecido a empresas, como aquelas na área jurídica ou na área da saúde, onde a administração de LLMs locais poderia resolver questões de privacidade.

À medida que o poder dos modelos locais de IA cresce, a equipe acredita que isso poderá reduzir a demanda por data centers de IA.

“Estamos vendo esse crescimento explosivo no espaço de IA, onde (os provedores de IA em nuvem) precisam expandir usando data centers e infraestrutura, mas sentimos que as pessoas ainda não perceberam o valor da IA local”, disse Pae. “Em vez de depender da nuvem, eles podem implantar um Mac Studio no local, e ele deve consumir substancialmente menos energia. Você ainda tem os recursos da nuvem, mas não dependerá de um data center para poder executar essa IA”, acrescentou.

Quando você compra por meio de links em nossos artigos, podemos ganhar uma pequena comissão. Isso não afeta nossa independência editorial.

Publicar comentário